✨︎ Resumen (TL;DR):

- Google detectó a un grupo cibercriminal creando un script en Python generado por IA para saltar la autenticación de dos pasos.

- El código tenía marcas claras de IA, como una puntuación CVSS alucinada que no existe en ninguna base de datos.

- Las capacidades de la inteligencia artificial ya están acortando el tiempo entre el descubrimiento de una falla y su uso como arma.

El Google Threat Intelligence Group (GTIG) bloqueó el primer caso confirmado de un grupo criminal utilizando inteligencia artificial para desarrollar un ataque informático crítico. Un exploit zero-day es un código malicioso que aprovecha una vulnerabilidad de software que el fabricante todavía desconoce. Los investigadores interceptaron la amenaza antes de que iniciara una campaña masiva para evadir la autenticación de dos factores en una herramienta web de código abierto.

El script de Python mostraba rastros innegables de haber sido generado por un modelo de lenguaje. El código incluía comentarios educativos, un menú de ayuda detallado, una clase de color ANSI limpia y una puntuación CVSS completamente alucinada.

“Finalmente descubrimos pruebas de que esto está ocurriendo”, indicó John Hultquist, analista jefe de GTIG. “Esto es probablemente la punta del iceberg y ciertamente no va a ser el último”.

Los atacantes explotaron un error semántico de lógica de alto nivel, no el clásico bug de corrupción de memoria. Los modelos de IA actuales logran identificar este tipo de suposiciones de confianza mediante razonamiento contextual. Google trabajó con el proveedor afectado para parchear la vulnerabilidad y mantuvo en secreto el nombre de la herramienta.

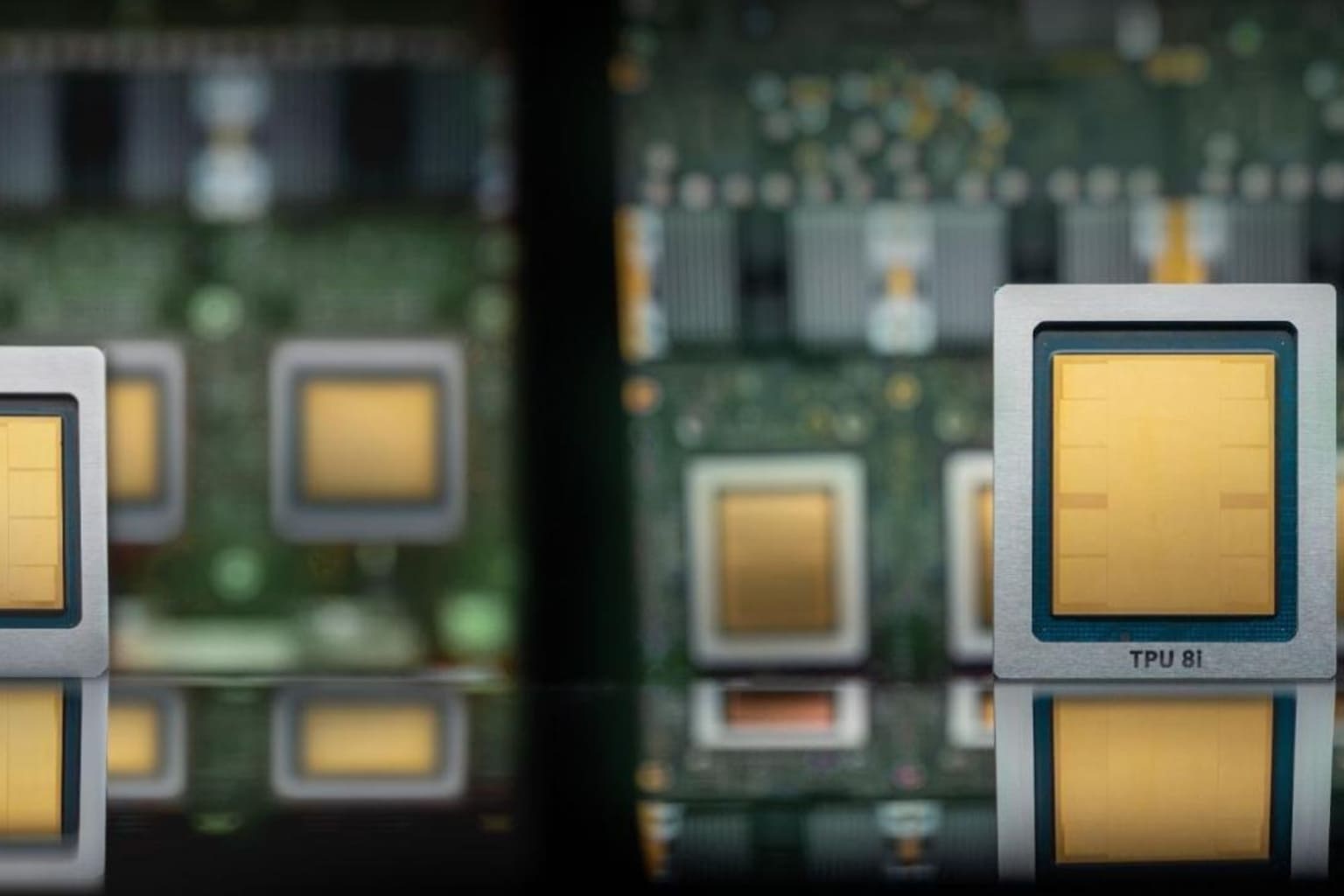

Amenazas impulsadas por el machine learning

El hallazgo expone una aceleración en las operaciones ofensivas a nivel global. Actores vinculados a China y Corea del Norte usan IA para buscar vulnerabilidades. Por su parte, grupos rusos despliegan malware con código señuelo generado artificialmente para evadir su detección.

Google también documentó PROMPTSPY, una puerta trasera en Android que utiliza la API de Gemini para navegar de forma autónoma por los dispositivos y ejecutar ataques de repetición biométrica.

El grupo responsable del zero-day en Python tiene un historial de incidentes de alto perfil. Google aclaró que los cibercriminales no utilizaron Gemini ni el modelo Mythos de Anthropic, pero no identificaron el sistema exacto.

Este incidente valida las métricas del informe de marzo de 2026 del GTIG, el cual rastreó 90 zero-days explotados en 2025 y advirtió que la inteligencia artificial aceleraría la creación de estas armas. El propio agente Big Sleep de Google demostró esta capacidad a finales de 2024 al encontrar una vulnerabilidad real antes que los atacantes.

“El juego ya comenzó y esperamos que la trayectoria de la capacidad sea muy pronunciada”, afirmó Hultquist. “Esperamos que esto sea un problema mucho mayor, que se produzcan ataques zero-day más devastadores mediante esta vía, especialmente a medida que crezcan las capacidades”.