✨︎ Resumen (TL;DR):

- Google busca desarrollar junto a Marvell una unidad de procesamiento de memoria y un nuevo TPU para modelos de lenguaje.

- La empresa proyecta un gasto de capital de entre $175 mil y $185 mil millones de dólares para su infraestructura en 2026.

- La alianza reduciría la dependencia exclusiva que Google tiene actualmente con Broadcom para fabricar silicio personalizado.

Google está en conversaciones con Marvell Technology para codiseñar dos nuevos chips de inteligencia artificial enfocados en operar modelos de forma más eficiente, según un reporte de The Information. Este movimiento permitirá a la matriz Alphabet diversificar a sus proveedores de silicio personalizado.

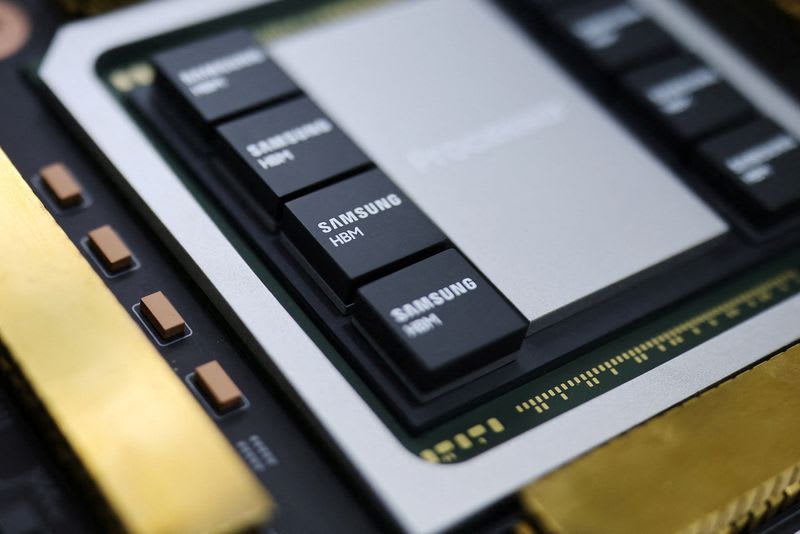

Las empresas discuten la creación de una unidad de procesamiento de memoria que trabajará con los actuales Tensor Processing Units (TPU) de Google, además de un nuevo TPU diseñado específicamente para ejecutar grandes modelos de lenguaje. Buscan finalizar el diseño de la primera unidad el próximo año para iniciar la producción de prueba.

Esta posible alianza altera la estrategia actual de Mountain View. Durante años, Broadcom operó como su principal socio de implementación. Apenas el 6 de abril, Broadcom anunció un acuerdo asegurado hasta 2031 para proveer componentes a Google y un pacto para otorgar a la startup Anthropic 3.5 gigawatts de cómputo en 2027.

Bajo el esquema tradicional, Google diseña la arquitectura del TPU, Broadcom lo convierte en un chip fabricable y TSMC lo produce. Si la negociación prospera, Marvell asumiría un rol de servicios de diseño para optimizar costos mediante su experiencia en interconexiones de alta velocidad.

El mercado multimillonario de la inferencia

Las empresas de la nube enfrentan una carrera por crear hardware especializado para la fase operativa de sus plataformas. La inferencia de IA es el proceso de ejecutar modelos previamente entrenados para generar resultados, una etapa técnica orientada a competir contra el dominio de Nvidia.

El posible acuerdo consolidaría a Marvell en el centro del ecosistema del hardware de IA, donde ya presenta cifras sólidas:

- Registró ingresos récord de $6.1 mil millones de dólares en centros de datos para el año fiscal 2026.

- Mantiene una tasa de ejecución anual de $1.5 mil millones de dólares en silicio personalizado a través de 18 contratos con proveedores de la nube.

- Amazon Web Services (AWS) es su principal cliente y colabora con Microsoft en el acelerador Maia AI.

- Nvidia realizó una inversión estratégica de $2 mil millones de dólares en Marvell el mes pasado para integrar chips personalizados con su red NVLink Fusion.

El mercado de componentes personalizados ASIC para centros de datos de IA alcanzará un valor de $118 mil millones de dólares para 2033. Considerando que el plan de inversión de Google para 2026 oscila entre $175 mil millones y $185 mil millones de dólares, la magnitud de su infraestructura tecnológica obliga a la compañía a operar con múltiples fabricantes en paralelo.