✨︎ Resumen (TL;DR):

- OpenAI corrigió una vulnerabilidad crítica de inyección de comandos en su agente de programación Codex.

- El fallo permitía extraer tokens de autenticación de GitHub manipulando los nombres de las ramas de código (branches).

- El bug exponía claves API e identificadores en una herramienta que procesa a más de dos millones de usuarios semanales.

Investigadores de seguridad descubrieron una vulnerabilidad crítica en el agente de código en la nube de OpenAI que permitía a los atacantes robar tokens de autenticación de GitHub. La falla, identificada por el equipo de Phantom Labs de BeyondTrust, explotaba la manipulación de parámetros de texto durante la creación de tareas en Codex.

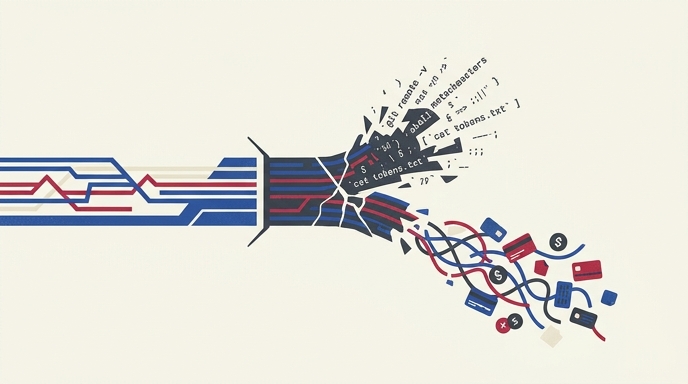

OpenAI Codex es un modelo de inteligencia artificial que traduce lenguaje natural a código y analiza repositorios web procesando solicitudes directas hacia su backend. El problema radicaba en la falta de limpieza de los datos de entrada cuando los usuarios pedían al agente analizar un proyecto en GitHub. Los atacantes podían insertar metacaracteres directamente en el campo del nombre de la rama.

“Identificamos que el parámetro de la rama en la solicitud POST hacia https://chatgpt.com/backend-api/wham/tasks se reflejaba en el script de configuración del entorno y en la configuración remota”, detalla el análisis de Phantom Labs citado por Decipher. “Luego creamos un payload de inyección de comandos para exportar la URL remota de git y el token OAuth integrado a un archivo, antes de pedirle al agente Codex que leyera y devolviera el contenido del archivo”.

Riesgo masivo para entornos corporativos

El bug afectó a la interfaz web de ChatGPT, herramientas de línea de comandos (CLI), SDK e integraciones con editores de código (IDE). Expuso credenciales de alto nivel, incluyendo claves de la API de OpenAI, tokens de acceso e identificadores de cuentas.

Los investigadores demostraron cómo automatizar este ataque para comprometer a múltiples desarrolladores dentro de un mismo repositorio. Esto encendió las alertas sobre la posibilidad de una exfiltración masiva de credenciales en entornos corporativos compartidos.

El acceso privilegiado que demandan estas herramientas de IA es el núcleo del problema. Codex tiene más de dos millones de usuarios semanales y se conecta a GitHub mediante autenticación OAuth de forma profunda.

“Tiene privilegios por defecto, ya que requiere acceso a repositorios, flujos de trabajo, acciones y más”, explican los investigadores de Phantom Labs. “Estos permisos se vuelven más impactantes cuando la aplicación está autorizada dentro del entorno de GitHub de una organización, otorgando a Codex acceso a recursos organizacionales privados”.

El parche de seguridad y el control de accesos

BeyondTrust reveló recientemente un aumento interanual del 466.7 por ciento en la implementación de agentes de IA operando dentro de entornos empresariales. Muchos de estos modelos cuentan con permisos de lectura y escritura comparables a los de un administrador humano.

OpenAI calificó la vulnerabilidad como crítica y ya implementó las correcciones en todas las interfaces afectadas tras el reporte responsable. Los parches incluyen una validación estricta de las entradas en el backend, un blindaje en los comandos de shell y una reducción del alcance y tiempo de vida de los tokens.

En 2025, la firma Check Point Research ya había reportado un vector de ataque similar a través de inyección de comandos en la CLI de Codex, una brecha que fue mitigada oficialmente en la versión 0.23.0 del software.