💡 Resumen (TL;DR):

- Nvidia presentó el rack Groq 3 LPX, integrando hardware de terceros en sus centros de datos por primera vez en su historia.

- El sistema promete un rendimiento de inferencia hasta 35 veces superior por megavatio para modelos de billones de parámetros.

- La infraestructura acelerará la generación de tokens para la nueva ola de sistemas de inteligencia artificial con agentes.

Nvidia aprovechó su conferencia GTC 2026 para romper sus propias tradiciones: incorporar hardware ajeno en su plataforma principal de centros de datos. La compañía presentó el rack Groq 3 LPX, un sistema de inferencia con refrigeración líquida que materializa el acuerdo de $20,000 millones de dólares firmado con la startup Groq en diciembre de 2025.

El anuncio confirma la asimilación tecnológica tras la compra de activos y la llegada a Nvidia de Jonathan Ross y Sunny Madra, líderes fundadores de Groq. Esta nueva arquitectura se compone de 256 unidades LPU que no reemplazan el ecosistema existente, sino que lo complementan.

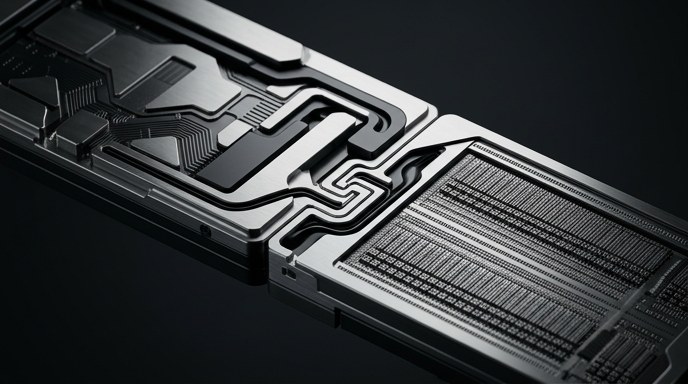

Una LPU (Unidad de Procesamiento de Lenguaje) es un procesador especializado que acelera la fase secuencial de decodificación para generar tokens de salida. A nivel individual, cada unidad aloja 500 megabytes de SRAM con 150 terabytes por segundo de ancho de banda.

Al escalar a un formato de rack completo, el sistema entrega 128 gigabytes de SRAM, 40 petabytes por segundo de ancho de banda agregado y 640 terabytes por segundo para la conexión entre chips. El diseño prescinde de switches tradicionales para usar enlaces directos, lo que permite al compilador programar el movimiento de datos con ejecución determinista.

El punto de inflexión en la inferencia

El hardware de Groq trabajará a la par de los gabinetes de GPU Vera Rubin NVL72. La distribución de carga es metódica: las GPU Rubin manejan las operaciones de atención y prellenado, mientras el LPX acelera la decodificación.

El CEO Jensen Huang justificó el desarrollo del sistema aludiendo a una “inflexión de inferencia” en la industria. Durante la keynote, advirtió que los sistemas de IA con agentes “consumen hasta 15 veces más tokens que las aplicaciones tradicionales”, exigiendo nuevas arquitecturas de hardware.

Detalles técnicos del despliegue y línea de producción:

- El sistema combinado soporta modelos de billones de parámetros con ventanas de contexto de un millón de tokens.

- Las primeras unidades utilizarán procesadores Intel para la comunicación entre chips, según The Information.

- La manufactura inicial de los chips Groq correrá a cargo de Samsung, antes de transicionar a TSMC.

- Nvidia evalúa fusionar la unidad LPU con su próxima arquitectura GPU Feynman, proyectada para 2028.

Los primeros racks Groq 3 LPX iniciarán envíos en la segunda mitad de 2026, junto a las otras seis configuraciones de la plataforma Vera Rubin. La decisión demuestra pragmatismo corporativo: sacrificar la exclusividad absoluta de su silicio a cambio de dominar la eficiencia energética frente a la carga bruta que demanda el nuevo software autónomo.