💡 Resumen (TL;DR):

- Jensen Huang solicitó a la industria construir plantas de memoria, garantizando la compra total.

- La arquitectura Vera Rubin (2026) usará HBM4, duplicando el consumo de recursos de memoria.

- El enfoque en IA ya duplicó el precio de los kits de memoria DDR4 para PC de escritorio.

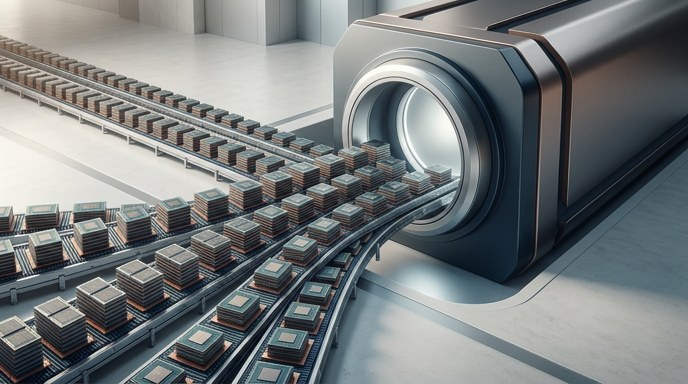

Durante la Conferencia de Tecnología, Medios y Telecomunicaciones de Morgan Stanley, el CEO de Nvidia, Jensen Huang, lanzó un mensaje directo a los fabricantes mundiales de chips: necesitan expandir su producción de inmediato. El directivo garantizó que consumirán todo el inventario de memoria que logren fabricar para alimentar sus servidores de inteligencia artificial.

“Si instalas una fábrica, una planta —una planta de DRAM— y yo llego y digo: ‘¿Sabes qué? Adelante, instala la planta de DRAM porque la voy a usar’, eso ayuda mucho”, explicó Huang a la audiencia. “Bien pueden llevar eso al banco, como muchos de ellos ya lo han hecho”.

El ejecutivo calificó la actual escasez de componentes, energía y espacio en los centros de datos como un diferenciador táctico para su compañía. “Me encantan las restricciones”, aseguró.

Huang sostiene que frente a limitaciones críticas, los clientes descartan el hardware experimental y compran opciones dominantes. “En un mundo de restricciones, no tienes más remedio que elegir lo mejor. No puedes desperdiciar tu elección”.

“Debido a que todo está tan restringido, si eliges mal, tus ingresos se ven afectados, todo se ve afectado. No pueden elegir mal”, añadió Huang, dejando claro por qué los corporativos prefieren su ecosistema.

Además, el CEO presumió su control sobre la manufactura de hardware: “Tengo todas las memorias, tengo todas las obleas, tengo todo el CoWoS”, refiriéndose a la tecnología de empaquetado avanzado que une el chip a la placa, indispensable para tareas de machine learning.

El peso técnico de Vera Rubin y HBM4

La urgencia del fabricante responde al inminente despliegue de su arquitectura de próxima generación, la plataforma Vera Rubin, que escalará su producción en la segunda mitad de 2026.

Este hardware exige un ecosistema masivo. HBM4 es un estándar de memoria de alto ancho de banda que triplica el área de silicio requerida frente a un módulo de DRAM convencional. Cada GPU soportará hasta 288 GB.

La firma financiera Longbridge señala que la complejidad técnica del HBM4 efectivamente duplica el consumo de memoria en comparación con los chips Blackwell actuales. Para intentar cubrir esta brecha, los proveedores líderes ya operan al límite:

- Samsung Electronics: Comenzó la primera producción masiva global de HBM4 en febrero de 2026, alcanzando velocidades de 11.7 Gbps, muy por encima del estándar base JEDEC. Su cuota de mercado proyectada es del 30%.

- SK Hynix: Domina el suministro global de componentes HBM reteniendo casi el 50% de las cuotas.

- Micron Technology: Apunta a capturar el 20% restante de esta industria crítica.

Toda la capacidad de estos tres titanes ya está prevendida hasta el cierre de 2026.

Esta reasignación de obleas de silicio hacia la inteligencia artificial golpeó de frente al usuario común. Los precios de la DRAM de consumo van al alza, y algunos kits de memoria DDR4 duplicaron su costo desde finales de 2025.

Debido a que levantar una fábrica de memoria avanzada exige tiempos de construcción de más de dos años, el mercado no experimentará un alivio en el suministro hasta 2027 o más allá. En un entorno sin margen de error, quien acapara el hardware base dicta las reglas del juego.