✨︎ Resumen (TL;DR):

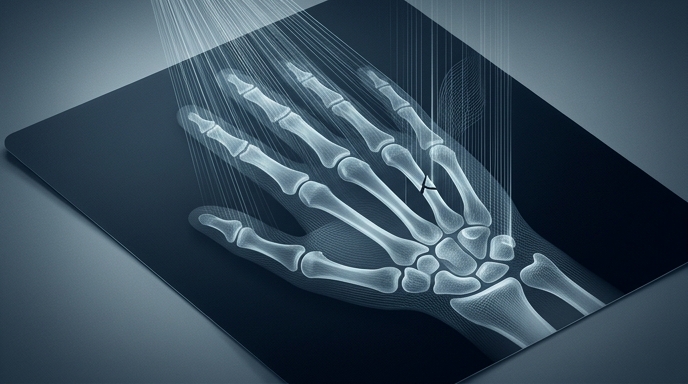

- Un estudio demuestra que la inteligencia artificial genera imágenes médicas capaces de burlar el análisis de profesionales humanos.

- Los radiólogos fallaron el 25% de las veces al intentar diferenciar entre radiografías auténticas y sintéticas.

- El hallazgo expone riesgos inminentes en diagnósticos de hospitales, fraudes de seguros y litigios legales.

Las imágenes de rayos X generadas por inteligencia artificial alcanzaron un nivel de realismo capaz de confundir a los profesionales mejor entrenados. Un estudio publicado el 24 de marzo en la revista Radiology reveló que los radiólogos solo distinguieron correctamente las imágenes reales de las sintéticas en un 75% de los casos, incluso cuando sabían que existían deepfakes dentro de la prueba.

La investigación reunió a 17 radiólogos provenientes de 12 centros de investigación en Estados Unidos, Francia, Alemania, Turquía, Reino Unido y Emiratos Árabes Unidos. Los especialistas analizaron 264 imágenes, compuestas en partes iguales por archivos auténticos y creados con IA.

Durante la primera fase del experimento, cuando los médicos desconocían el objetivo real del estudio, apenas el 41% sospechó de forma espontánea que el dataset contenía material sintético.

“Nuestro estudio demuestra que estas radiografías deepfake son lo suficientemente realistas como para engañar a los radiólogos, los especialistas en imágenes médicas mejor capacitados, incluso cuando sabían que había imágenes generadas por IA presentes”, explicó Mickael Tordjman, autor principal y especialista de la Escuela de Medicina Icahn en Mount Sinai, Nueva York.

La precisión individual varió drásticamente, fluctuando entre el 58% y el 92%. Curiosamente, la experiencia clínica —que iba desde cero hasta 40 años— no mejoró la capacidad de detección de los participantes. Solo los especialistas musculoesqueléticos superaron el promedio.

El riesgo de la perfección artificial

El experimento también evaluó grandes modelos de lenguaje (LLM) como GPT-4o y Gemini 2.5 Pro. Estas plataformas alcanzaron tasas de precisión del 57% al 85% al analizar imágenes generadas por ChatGPT.

El problema trasciende a los departamentos de radiología. Tordjman advirtió sobre “una vulnerabilidad de alto riesgo para litigios fraudulentos si, por ejemplo, una fractura inventada pudiera ser indistinguible de una real”. Además, advirtió sobre el peligro de hackers inyectando imágenes sintéticas en las redes de los hospitales para manipular diagnósticos.

Elisabeth Bik, microbióloga y experta en integridad de imágenes, declaró a la revista Nature que los hallazgos son “tanto inquietantes como no muy sorprendentes”. Añadió que la amenaza compromete “la integridad de la investigación, los flujos de trabajo clínicos, las reclamaciones de seguros y los contextos legales donde se utiliza evidencia de imágenes”.

“Las imágenes médicas deepfake a menudo se ven demasiado perfectas”, detalló Tordjman. Para identificar los engaños, los expertos detectaron patrones específicos:

- Huesos con texturas excesivamente lisas.

- Columnas vertebrales alineadas de forma antinatural.

- Patrones de vasos sanguíneos demasiado uniformes.

Para blindar los sistemas de salud, el equipo de investigación propuso implementar firmas criptográficas y marcas de agua invisibles incrustadas en el archivo original desde el momento en que se captura la radiografía.

“Potencialmente, solo estamos viendo la punta del iceberg”, advirtió Tordjman. “El siguiente paso lógico en esta evolución es la generación por IA de imágenes 3D sintéticas, como tomografías computarizadas y resonancias magnéticas. Establecer datasets educativos y herramientas de detección ahora es crítico”.