✨︎ Resumen (TL;DR):

- AWS abrió las puertas de Annapurna Labs en Texas para exhibir el desarrollo de sus procesadores Trainium.

- OpenAI se comprometió a consumir 2 gigawatts de capacidad de cómputo y ampliará su contrato de nube en 100 mil millones de dólares.

- Los nuevos chips de Amazon prometen ahorros del 50% en el entrenamiento de IA, posicionándose como el mayor rival de Nvidia.

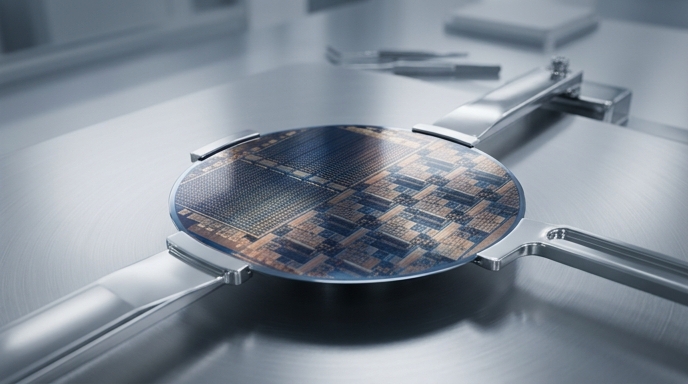

Amazon Web Services (AWS) abrió este fin de semana las puertas de Annapurna Labs en Austin, Texas, para mostrar el diseño y pruebas de sus procesadores de IA Trainium. El movimiento ocurre semanas después de anunciar una inversión de 50 mil millones de dólares en OpenAI, consolidando su hardware como un retador frente al dominio de Nvidia.

El pacto del 27 de febrero certifica las ambiciones de Amazon en el mercado de silicio personalizado. OpenAI acordó utilizar 2 gigawatts de capacidad Trainium mediante AWS, convirtiendo a la empresa en su proveedor de nube de terceros exclusivo para OpenAI Frontier.

Para blindar la alianza técnica, OpenAI también expandió su contrato comercial de AWS por 100 mil millones de dólares a lo largo de ocho años.

La inyección de capital por parte de Amazon se dividió en 15 mil millones de dólares iniciales y 35 mil millones sujetos a metas operativas. Esto formó parte de la ronda récord de 110 mil millones levantada por OpenAI, donde SoftBank y Nvidia participaron con 30 mil millones cada uno.

La firma financiera William Blair calificó el movimiento como un gran voto de confianza hacia la estrategia de chips de Amazon.

El músculo operativo de AWS y Trainium3

AWS ya desplegó 1.4 millones de chips Trainium2. Toda esta capacidad está agotada comercialmente y soporta la mayoría de las cargas de inferencia en el ecosistema de la nube. Amazon Bedrock es un servicio de inteligencia artificial administrado que permite usar y personalizar modelos fundamentales para más de 100,000 empresas.

El hardware de Amazon también sostiene Project Rainier de Anthropic en Indiana, considerado el clúster de cómputo de IA operativo más grande del mundo, con más de 500,000 procesadores ejecutando los modelos Claude.

Apple es otro jugador que adoptó la tecnología. Usa chips Inferentia y Graviton para servicios de búsqueda y actualmente evalúa Trainium2 para preentrenar Apple Intelligence, esperando obtener mejoras de eficiencia del 50 por ciento.

En diciembre inició la producción de la nueva generación, Trainium3. Estos procesadores integran tecnología NeuronSwitch para comunicación de baja latencia entre componentes y soporte nativo para el framework PyTorch, lo que evita que los desarrolladores reescriban su código.

“Los chips Trainium podrían reducir el costo de desarrollar y operar modelos de IA generativa hasta en un 40 por ciento en comparación con las GPU”, declaró a la agencia AFP Kristopher King, líder del laboratorio en Austin.

El director general de Amazon, Andy Jassy, confirmó que el negocio de chips personalizados ya supera los 10 mil millones de dólares en ingresos anuales. Mientras tanto, la compañía ya diseña Trainium4, arquitectura que multiplicará por seis su potencia de procesamiento.