✨︎ Resumen (TL;DR):

- Ollama lanzó la versión preliminar 0.19 integrando el framework MLX de Apple para optimizar modelos de IA.

- El nuevo motor procesa prompts 1.6 veces más rápido y casi duplica la velocidad de generación de respuestas.

- Los chips M5 alcanzan 1,851 tokens por segundo aprovechando los aceleradores neuronales integrados.

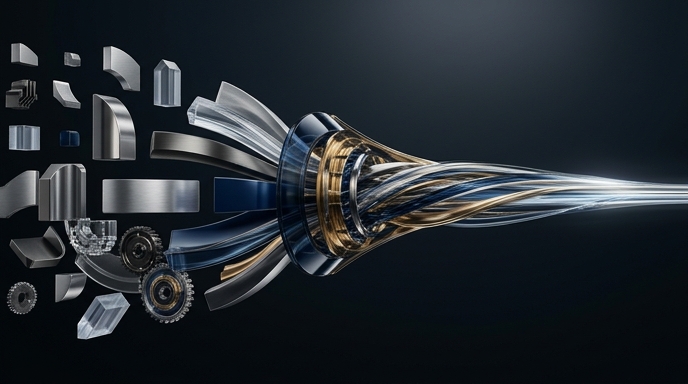

Ollama presentó la versión preliminar 0.19 de su motor de inferencia, la cual integra de forma nativa el framework de Apple. Esta actualización optimiza la ejecución local de modelos de IA en equipos Mac con Apple Silicon, logrando procesar prompts 1.6 veces más rápido y duplicando la velocidad de generación frente a la versión anterior.

Para lograr este salto de rendimiento, la plataforma reemplazó su antiguo backend basado en llama.cpp para macOS. MLX es un framework open-source de arrays que Apple diseñó específicamente para aprovechar su arquitectura de memoria unificada, lo que permite a la CPU y la GPU compartir recursos sin el desgaste de mover datos constantemente.

El hardware de nueva generación obtiene los mayores beneficios. En los procesadores M5, M5 Pro y M5 Max, Ollama utiliza los Aceleradores Neuronales de GPU. Investigaciones de Apple indican que estos componentes alcanzan una velocidad hasta 4 veces mayor en la generación del primer token al compararse con la arquitectura M4.

Según pruebas internas realizadas el 29 de marzo de 2026, la versión 0.19 ejecutando cuantización int4 registró 1,851 tokens por segundo en prefill y 134 tokens en decodificación.

Los desarrolladores señalaron que están “trabajando activamente para soportar futuros modelos”, ya que esta fase de prueba solo admite el modelo Qwen3.5-35B-A3B de Alibaba, optimizado para programación. Su ejecución exige una Mac con más de 32GB de memoria unificada.

Soporte para agentes de código y formato de NVIDIA

Esta actualización busca facilitar tareas pesadas a nivel local. Ollama destacó los siguientes casos de uso y características técnicas:

- Ejecución de agentes de código como Claude Code, OpenCode y Codex.

- Soporte nativo para asistentes personales como OpenClaw.

- Integración del formato de cuantización NVFP4 de NVIDIA, que reduce los requisitos de ancho de banda de memoria manteniendo la precisión de los modelos, igualando el estándar de la nube.

La decisión de adoptar MLX nativamente responde a las demandas de la comunidad. Pruebas recientes publicadas en Reddit expusieron que el framework de Apple generaba tokens tres veces más rápido que el antiguo motor de Ollama, una brecha técnica que esta actualización cierra por completo.