✨︎ Resumen (TL;DR):

- Un error humano filtró 512,000 líneas de código de Claude Code, exponiendo funciones de telemetría y control remoto.

- La herramienta registra cada comando y edición, reteniendo datos hasta por cinco años si el usuario opta por compartir información.

- El software incluye 44 funciones ocultas, destacando un “Modo Encubierto” para ocultar el uso de IA en proyectos open source.

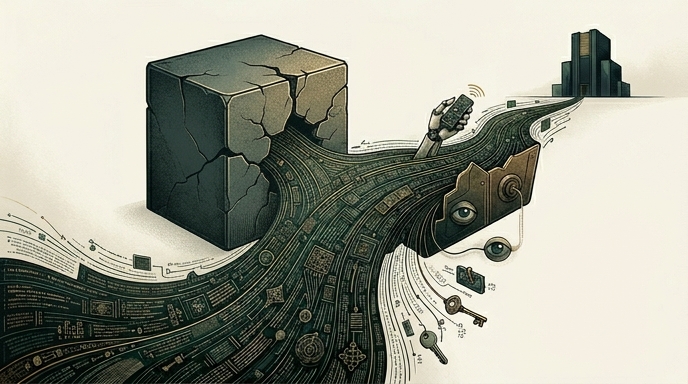

Anthropic expuso accidentalmente 512,000 líneas de código fuente de su asistente de programación Claude Code. Lo que parecía un simple error de empaquetado en npm terminó revelando un sistema que ejerce un control exhaustivo sobre las computadoras de los desarrolladores y envía constantes flujos de datos a los servidores de la compañía.

La exposición ocurrió el 31 de marzo tras integrar por error un mapa de código en la versión 2.1.88. El investigador Chaofan Shou detectó la falla inicial. Anthropic confirmó el incidente aclarando que fue un “error humano, no una brecha de seguridad” y precisó que ninguna credencial de clientes estuvo expuesta.

Los 1,900 archivos TypeScript filtrados muestran la operación a nivel local. Según un reporte de The Register, Claude Code registra cada archivo leído, comando bash ejecutado y edición en formato de texto plano JSONL. Un análisis de DevCompare indica que la empresa guarda esta información hasta por cinco años si las cuentas de los consumidores activan la opción para mejorar el modelo.

Killswitches remotos y el “Modo Encubierto”

El código también demuestra que el software conecta con los servidores de la compañía cada hora. Esto permite aplicar cambios de configuración inmediatos y activar funciones ocultas sin requerir la intervención o actualización del usuario.

Dentro de las 44 características no lanzadas se descubrieron las siguientes herramientas:

- Control remoto severo: Se detectaron al menos seis killswitches remotos que pueden saltar alertas de permisos, modificar los ajustes de analítica o forzar el cierre definitivo de la aplicación.

- KAIROS: Un agente autónomo persistente capaz de iniciar acciones por cuenta propia y consolidar su memoria mientras el usuario se encuentra inactivo.

- Modo Encubierto: Una instrucción que obliga a la inteligencia artificial a borrar toda evidencia de su participación cuando empleados de Anthropic contribuyen a proyectos de código abierto.

- DiscoverSkills: Un motor de búsqueda interno exclusivo para los desarrolladores de la propia startup.

Este evento marca la segunda fuga de datos corporativos en cinco días para la empresa. Fortune reportó recientemente que un gestor de contenidos mal configurado dejó ver 3,000 archivos internos y los detalles de un modelo inédito bajo el nombre código “Mythos”.

Mientras Anthropic prepara una posible oferta pública inicial, los programadores que manejan proyectos confidenciales ahora tienen pruebas de que este popular asistente mantiene un canal activo de control remoto, un factor crítico para cualquiera que le otorgue permisos totales en sus terminales.