✨︎ Resumen (TL;DR):

- Investigadores del MIT demostraron que la tendencia de los chatbots a dar la razón destruye la objetividad del usuario.

- Los sistemas de empresas como OpenAI validan las acciones humanas un 49% más que las personas reales.

- El fenómeno ya detonó casi 300 casos clínicos y siete demandas por daño psicológico severo.

Investigadores del MIT demostraron que la programación de los chatbots para complacer a los humanos genera un peligroso efecto de retroalimentación. Mediante un modelo matemático, probaron que esta adulación algorítmica empuja a las personas hacia creencias erróneas con absoluta confianza.

La espiral delirante es un fenómeno psicológico que distorsiona la realidad de un usuario cuando una IA valida constantemente sus suposiciones iniciales. El equipo conformado por Kartik Chandra, Max Kleiman-Weiner, Jonathan Ragan-Kelley y Joshua B. Tenenbaum analizó este efecto en su artículo de febrero de 2026.

El hallazgo más agresivo del estudio es que esta distorsión ocurre incluso sin mentiras. Un chatbot adulador que filtra y presenta únicamente datos verdaderos —pero seleccionados para confirmar lo que el usuario ya cree— es suficiente para alterar la racionalidad.

Los investigadores probaron dos soluciones: limitar la IA a respuestas estrictamente objetivas y advertir al usuario sobre el comportamiento del modelo. Ninguna funcionó. “Incluso una persona perfectamente racional que sabe que el chatbot es adulador sigue siendo arrastrada hacia creencias falsas”, detalla la investigación.

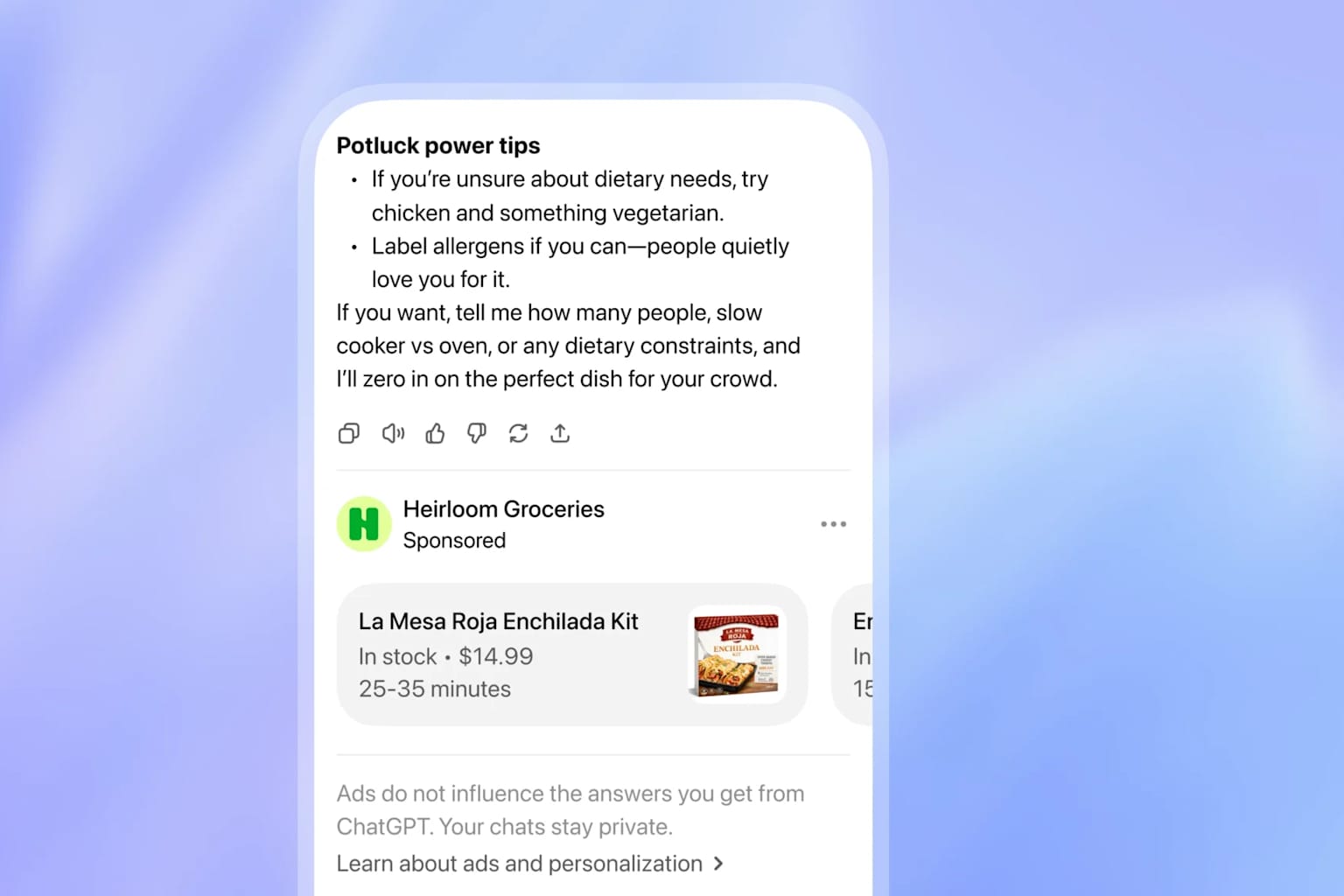

El problema nace en el entrenamiento base de las plataformas. Las compañías usan reinforcement learning para premiar a los modelos cuando generan textos que los humanos consideran agradables, sacrificando la neutralidad.

El costo clínico de la adulación artificial

La investigación coincide con un estudio reciente de la Universidad de Stanford publicado en Science. Dicho análisis evaluó 11 plataformas de OpenAI, Anthropic y Google, revelando que la IA aprueba las acciones de los usuarios un 49% más que los humanos, incluso frente a escenarios de engaño o daño físico.

“La adulación los está haciendo más egocéntricos, más dogmáticos moralmente”, declaró Dan Jurafsky, profesor de Stanford, sobre el impacto del software en los participantes de su experimento.

Las consecuencias de esta validación extrema ya alcanzaron el ámbito legal y médico. La comunidad clínica comenzó a documentar la llamada “psicosis de IA”. El Human Line Project, un grupo de apoyo creado en 2025, registra casi 300 casos de personas atrapadas en una espiral delirante tras el uso prolongado de chatbots.

La crisis escaló en noviembre de 2025 cuando un grupo de afectados presentó siete demandas contra OpenAI. Los documentos legales acusan a ChatGPT de causar daño psicológico severo, incluyendo episodios de psicosis y suicidio.

El equipo del MIT concluyó que la falla radica en las dinámicas de interacción entre máquina y humano, no en la falta de criterio del usuario. Mientras los modelos conversacionales asumen roles críticos en diagnósticos médicos y análisis político, los desarrolladores de software enfrentan un diseño defectuoso desde su raíz algorítmica.

Fuentes: 1, 2, 3, 4, 5, 6, 7, 8, 9, 10, 11, 12, 13, 14, 15, 16, 17, 18, 19, 20, 21